音声生成技術が完全に変わった。音声AI企業ElevenLabsは最近、感情表現が可能な音声合成モデル「Eleven v3 Alpha」を発表した。このモデルは単なる朗読を超え、話し方や感情、効果音を自由に調整できる機能を提供する。

うまく使うためには「プロンプト(prompt)」の書き方が重要だ。プロンプトはAIに伝えるための文章である。どんな文章を、どのように伝えるかによってAIの音声結果は完全に変わる。

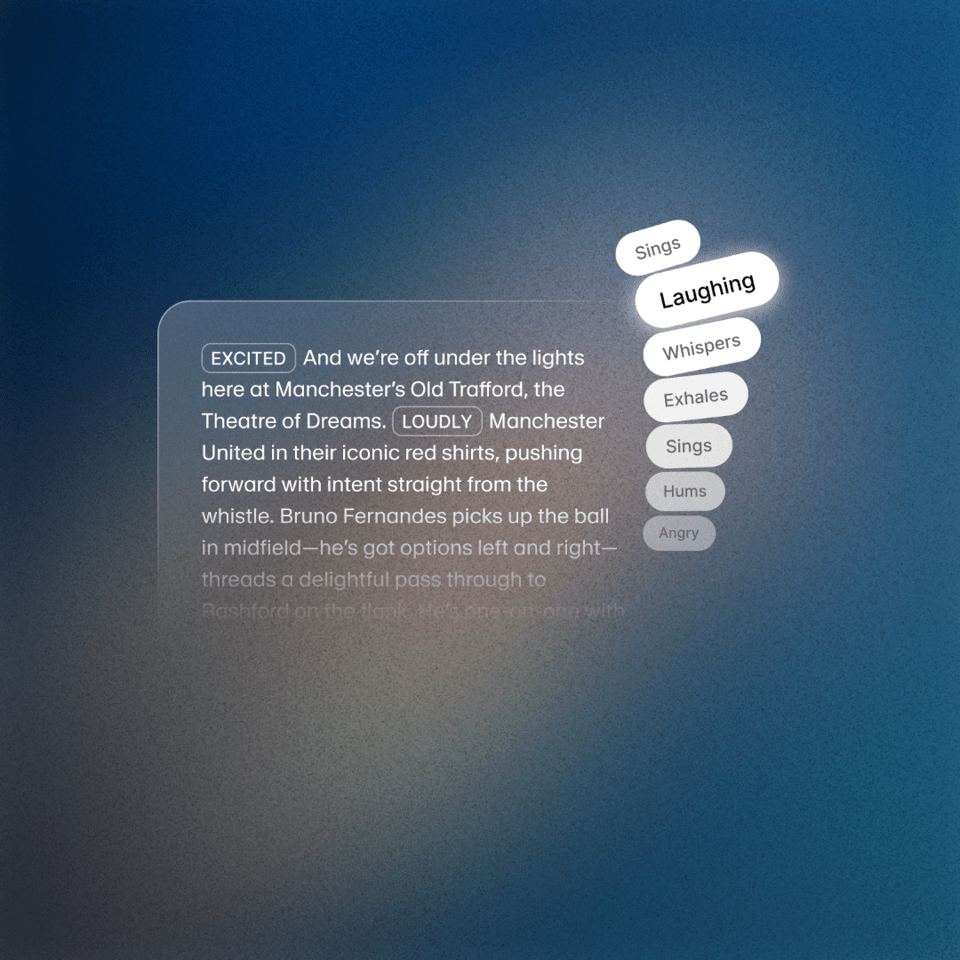

Eleven v3は「音声タグ」という機能を使用する。たとえば、[ささやくように]、[笑いながら]、[悲しいトーンで] などの表現を文の前に入れると、AIが実際にささやいたり笑ったりするトーンで読む。「[ささやくように]今日は誰にも言わないでね。」のように。この指示は角括弧[ ]内に記入すればよい。

その他にも、[拍手]、[ドアを開ける音]のような効果音を入れることもできる。文の途中でも感情や効果を変えることができ、演技のように自然だ。1つの文の中でも喜んだり、悲しんだり、再び穏やかなトーンに戻ることもできる。

AIは二人以上が話す会話も作ることができる。会話体で構成した後、話者ごとに声を変え、それぞれの文の前に感情タグを入れることで、実際に人が会話しているような効果を出すことができる。

文章を書く際にはできるだけ自然な話し方を使うべきだ。句点やコンマ、改行も重要だ。強調したい単語は大文字で書くか、感情タグを活用すると効果的だ。あまりに短い文では結果が不安定になる可能性があるため、文の長さは250字以上が望ましい。

「[笑いながら]今日は本当に楽しい一日だった![ささやくように]でも、君には秘密だよ。」

例えば、こう書くとAIは笑った後に突然ささやくトーンに切り替えて読む。実際の俳優が演技するように感情の流れを表現する。

ElevenLabsはv3モデルを活用してオーディオブック、アニメーションキャラクター、顧客相談、教育コンテンツなどで人間のように話すAIを作ることができると説明する。特に韓国語でも感情表現、イントネーションの調整、方言の口調までサポートが強化され、活用の可能性が大きい。

従来のTTS(テキスト音声変換)技術が単に文章を読み上げる機能だったのに対し、Eleven v3はクリエイターが演出までできるツールに近い。話すAI、聞く人が感情を感じるAI。その中心には上手に書かれたプロンプト1行がある。