オープンAIの最高経営責任者(CEO)であるサム・アルトマン氏は、最新の人工知能モデルであるGPT-4oの幻覚率が以前よりも悪化していることを認め、次世代モデルではこの問題を大幅に改善すると発表しました。彼はAIがユーザーに心理的に与える影響について懸念を表明し、技術的な緩和措置とともにプライバシーおよび精神健康の保護策を併行して行う方針を示しました。

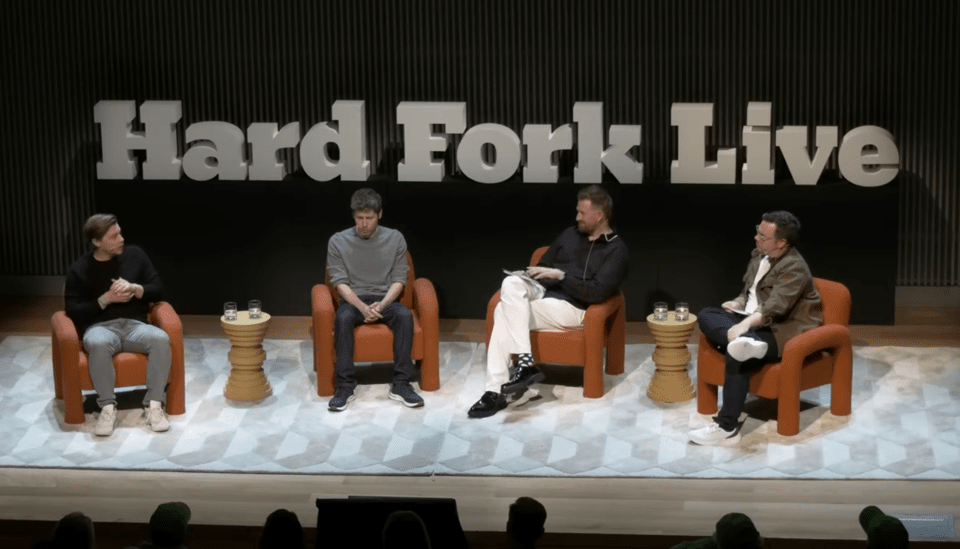

アルトマン氏は、最近アメリカのサンフランシスコで行われたポッドキャスト『ハードフォーク』のライブインタビューに参加し、「GPT-4oの幻覚率がGPT-4に比べて少し高くなったのは事実である」と述べ、次のバージョンではこれをはるかに改善できるだろうと語りました。彼は現在が推論モデルを整列させ、ユーザーの使用方法を学ぶ初期段階であると説明し、これまで多くを学び、次世代モデルではユーザーの満足度が高まると自信を示しました。

幻覚(hallucination)は、生成型AIが存在しない情報をあたかも事実のように作り出すエラーで、その深刻さについての懸念が続いています。特にインタビュアーは、GPT-4oが以前よりも虚偽情報を頻繁に生成し、時には巧妙で的外れな主張をすると指摘しました。

AIがユーザーに与える心理的影響に関する議論も続いています。インタビュアーは、最近GPT-4o使用中の一部のユーザーが陰謀論的な思考に陥ったり神秘体験をするなど、不安定な状態を訴える事例が増加していると述べました。これに対してアルトマン氏は、「OpenAIはこの問題を非常に深刻に受け止めており、過去の技術企業のように対応が遅れないよう努力している」と語りました。

OpenAIはこれを緩和するためにさまざまな措置を講じています。ユーザーが危機に瀕していると判断された場合は専門家の助けを勧め、会話が否定的な方向に流れた場合には中断させたり、別の方向を提示する機能も導入しました。特に、AIに過度に依存しないように注意を与える警告文句も設定されており、ユーザーがこれを個別に設定変更できる点も言及されました。しかし、アルトマン氏は「精神的に極度に脆弱なユーザーに対してこのような警告がどのように伝えられるか、まだ解決されていない部分がある」と述べました。

アルトマン氏はAIの副作用を認めつつも、ポジティブな活用事例が多いことを強調しました。彼は「AIが実際に人々の結婚生活を回復するのに役立ったり、家族間のコミュニケーションを改善するのに貢献した事例が存在する」とし、「これらのポジティブな事例があるため、AI技術は純粋にポジティブである」と評価しました。彼はコスタリカで出会った一人の男性がChatGPTのおかげで結婚生活を回復したという逸話を挙げ、AIが人間関係の回復に対する期待感を示しました。

今回のインタビューは、AI技術の進展とともに際立つ幻覚、プライバシー、精神健康問題を総合的に探ったという点で注目されています。アルトマン氏は「OpenAIは単に技術を開発するだけでなく、それを巡る社会的責任も共に考慮する」と強調しました。