クラウドなしで自分のコンピュータ上でAIを直接実行できるオラマ、アップル専用技術で再設計

以前のバージョンに比べ、最大11倍の処理速度向上。コーディングAIエージェント連動も正式サポート。

32GB以上のメモリを持つMacが必要。現在はアリババのQwenモデルを中心にサポート。

オラマが目指すものは何か

AIを利用する方法は大きく2つあります。ChatGPTのようにインターネットを介してサーバに接続する方法と、AIモデルを自分のコンピュータにダウンロードして実行する方法です。後者は「ローカルAI」と呼ばれます。

ローカルAIは個人情報が外部に流出せず、インターネットがなくても利用できる利点があります。セキュリティが重視される企業環境や、敏感な情報を扱う作業で特に注目されています。問題となるのは設置と実行が複雑であることです。一般ユーザーはもちろん、開発者にも手を出しにくい領域でした。

オラマはこの不便さを解決するために作られたプログラムです。複雑な設定なしにコマンド一つでAIモデルを自分のコンピュータにダウンロードしてすぐに実行できるようにします。このためローカルAI分野で最も広く使用されるツールの一つとなっています。3月30日に公開されたバージョン0.19は、その性能を一段と高めたアップデートです。

速度が変わった…数字で見ると

今回のアップデートの核心はAppleとの結合です。オラマ0.19はAppleが独自開発した機械学習専用基盤「MLX」で動作するよう新たに設計されました。Appleチップ特有のメモリ構造を最大限に活用するようにカスタム設計した結果、速度が目に見えて変わりました。

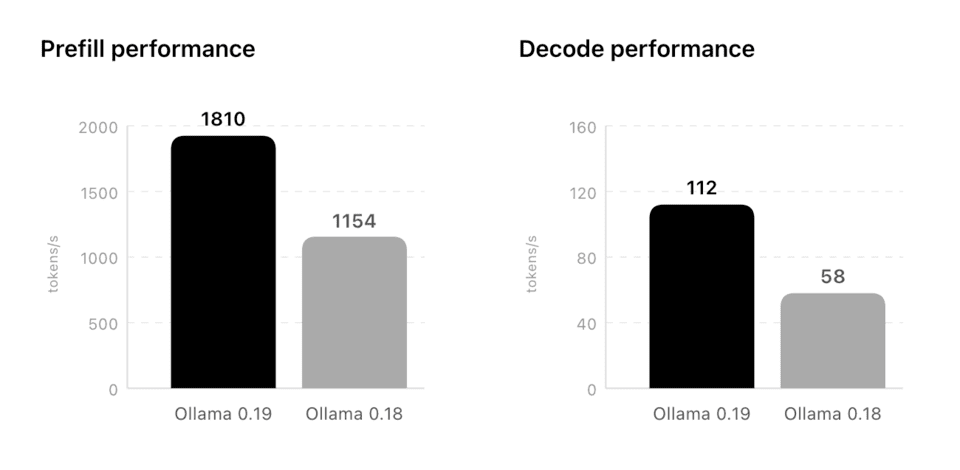

先月29日にアリババのAIモデルを基準にテストした結果がこれを裏付けています。AIが長文を読み理解する速度、すなわち「プリフィル」性能が以前のバージョンに比べ約11倍速くなりました。

以前は1秒間に154個の単位を処理していましたが、新バージョンでは1秒間に1,810個を処理します。AIが応答を作成し画面に出力する速度も以前より約93%向上しました。1秒間に58個から112個に増加しました。

最新のM5・M5 Pro・M5 Maxチップでは、チップ内に組み込まれた専用演算装置を初めて活用し、この数値をさらに高めました。

コーディングAIと接続される

今回のアップデートで見逃せない変化がもう一つあります。コーディング専門AIエージェントとの正式な連動です。クロードコード、オープンコード、コーデックスのようなツールがその対象です。これらのツールは、開発者がコードを作成したりエラーを修正したりする際にAIが直接支援する方式で動作します。今やこれらのツールを自分のコンピュータ内で稼働させることができるようになりました。

これを可能にした技術の一つがキャッシュ改善です。キャッシュとは頻繁に使う情報を事前に保存しておく空間です。オラマ0.19はこのキャッシュを会話と会話の間で再利用できるように変更しました。クロードコードのように同じ基本命令を繰り返して使うツールを用いると、メモリ使用量が減り応答が速くなる効果が出ます。プロンプトの重要なポイントごとに自動で中間保存をしておく機能も新たに追加されました。これにより、以前の会話の一部が消滅しても最初から再処理する必要がなくなります。

また、エンビディアのNVFP4フォーマットのサポートも今回追加されました。AIモデルの正確性はそのままに、メモリ使用量と保存容量を減らす技術です。クラウドサービス事業者が実際の運用環境で使用するものと同じフォーマットを個人のコンピュータでも使えるようになったことが注目されます。

誰でも使えるものではない

期待通りに現実的な条件もあります。今回のプレビュー版を完全に活用するには統合メモリ32GB以上のMacが必要です。統合メモリとは、CPUとGPUが共に使用する共有メモリで、AppleシリコンMacの構造的な特徴です。基本型MacBook Air(16GB)では今回の主力モデルの稼働が難しいということを意味します。

サポートモデルも現在はアリババのQwen3.5-35B-A3Bに限定されています。オラマ側は今後、より多くのモデルをサポートする計画を明らかにしましたが、具体的な時期は公表していません。ユーザーが自分で作成したカスタムモデルを持ってくる方法もまだ制限的です。

自分のコンピュータでAIが稼働するということは、情報が外部サーバに漏れないということを意味します。速度とセキュリティを同時に捉えるという試みが今回のアップデートの本質です。ローカルAIが一部の開発者の実験ではなく実用的な選択肢として定着するまで、オラマ0.19はその流れを一歩進めるアップデートとして記録されるでしょう。