グーグルは人工知能(AI)の概念をさらに一歩進めました。これまでAIは、文章を書くや絵を描くなど、言語や画像中心の領域にとどまっていました。しかし、グーグルが7日(現地時間)に新たに公開した『ジェミナイ(Gemini)2.5コンピュータユーズ(Computer Use)モデル』は、AIが単に情報を生成するレベルを超え、実際のコンピュータ画面を直接操作できるように設計されました。

グーグルはこのモデルを自社AIプラットフォーム『ジェミナイ2.5プロ(Gemini 2.5 Pro)』の視覚認識と論理的推論能力を基に開発しました。

このモデルは、ユーザーが与えた命令を理解し、ウェブページやアプリ画面のボタンをクリックしたりテキストを入力したりして自ら作業を実行します。例えば、ウェブサイトの会員登録フォームを記入したり、スプレッドシートにデータを入力したり、予約システムでスケジュールを取る作業などがすべて可能です。

グーグルはこのモデルを「ウェブとモバイル環境の両方で既存のAIよりも正確で速い反応速度を備えた新しい形態のAI」と紹介しました。開発者は『グーグルAIスタジオ(Google AI Studio)』や『バーテックスAI(Vertex AI)』プラットフォームを通じてこの機能を利用できます。

従来のAIは主に『API(アプリケーションプログラムインターフェース)』を通じてデータをやり取りする方式で作動していました。しかし、実際のデジタル業務の多くは依然として人間が直接画面を見て操作しなければならない段階にとどまっています。例として、ウェブサイトの入力欄に情報を入力しボタンを押して提出する行為は人が行う代表的な作業です。

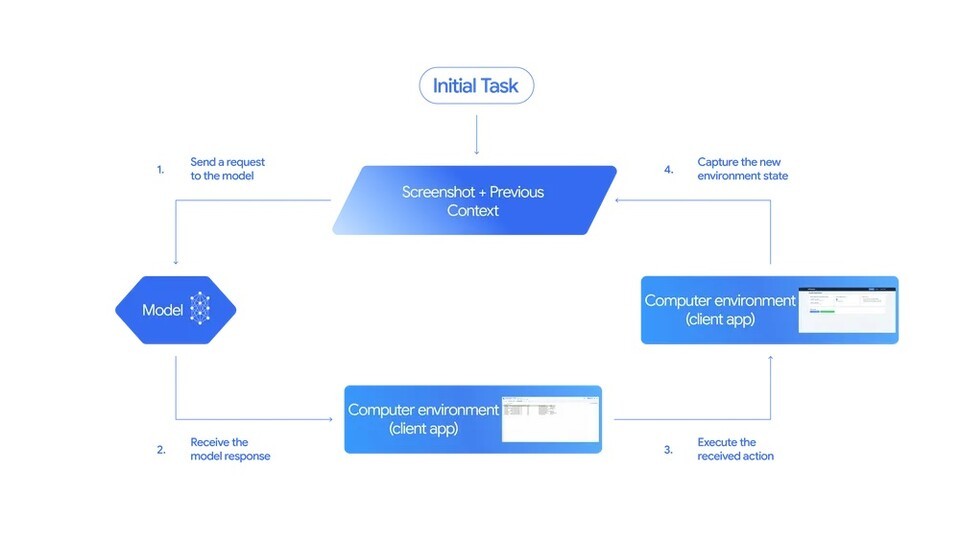

『ジェミナイ2.5コンピュータユーズモデル』はこのプロセスを自動で行います。ユーザーのリクエストと共に画面のスクリーンショット、そして直前の行動記録を取得し、その情報を分析して「どのボタンを押すべきか」、「どの文を入力するべきか」を判断します。AIが下した判断は『クリック』、『入力』、『スクロール』といった命令に変換され実際の画面で実行されます。

作業が実行された後には新しい画面がモデルに再び渡され、このプロセスを繰り返しながら目標作業を完了します。グーグルはこれを「AIが画面を見て行動を繰り返しながら作業を完結するループ(loop)構造」と説明しました。これまでAIが「言語でしか働かない存在だった」とすれば、今回のモデルは「目と手を持ったAI」に近い概念です。

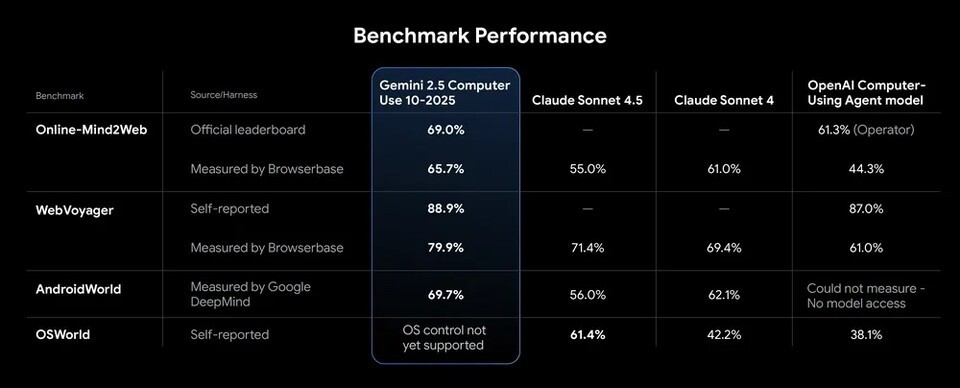

グーグルはジェミナイ2.5コンピュータユーズモデルがウェブとモバイル操作能力を評価するさまざまな基準で競争モデルを上回ったと発表しました。『オンラインマインドツーウェブ(Online-Mind2Web)』、『ウェブボイジャー(WebVoyager)』、『アンドロイドワールド(AndroidWorld)』など主要な性能評価で全て上位にランクされました。

特にウェブブラウザ操作性能を測定するブラウザベース(Browserbase)テストでは正確度70%以上、遅延時間約225秒で業界最高水準を示しました。即ち、同じ作業をする際により速く、より正確に画面を操作できるという意味です。グーグルは「ブラウザ制御品質が最も高く、遅延時間は最も低いモデル」と説明しました。

AIが直接コンピュータを操作するため、セキュリティと安全性の確保は主要な課題となりました。グーグルはこの問題を考慮しモデル設計段階から多数の安全装置を組み込みました。

まず、モデルが実行される前に各行動の危険性を事前に評価する『段階別安全サービス(per-step safety service)』を適用しました。この機能はAIが実行しようとする操作がシステムに影響を与えたり、セキュリティ上のリスクになる可能性を判断して遮断します。

また、開発者が高リスク作業に分類される決済、セキュリティ設定の変更、個人情報へのアクセスなどの行動に対してAIが自動で実行しないよう制限できる『システム指示(System instructions)』機能を追加しました。必要に応じてユーザーの確認を経て命令を実行するように設定することもできます。

この他にもグーグルは開発者にセキュリティ関連のガイドラインを提供し、認証プロセスとデータ保護原則を徹底的に遵守するようにしました。同社は「AIがウェブ環境で悪意あるリンクをクリックしたり、システム設定を無断で変更しないよう設計されている」とし「全ての開発者は実際のサービスを展開する前に必ず安全性を検証しなければならない」と明らかにしました。

ジェミナイ2.5コンピュータユーズモデルはすでにグーグルの内部システムと外部パートナー企業で実験的に使用されています。グーグルの決済プラットフォーム開発チームはUIテストに適用し、過去のテスト失敗の約25%を削減したと述べました。従来はエラーを修正するのに数日かかっていましたが、AIが画面を自ら分析し、対処することで復旧率が60%以上改善されました。

外部パートナーのメッセージングベースAI助手サービス『ポーク(Poke.com)』は「作業速度が競合モデルより50%速く、正確度も大いに向上した」と評価しました。自動化エージェント企業『オートタブ(Autotab)』も「複雑なデータ収集環境で性能が18%改善された」と述べました。

グーグルは今日日からジェミナイ2.5コンピュータユーズモデルを公開プレビュー形式で提供し始めました。開発者はグーグルAIスタジオとバーテックスAIでその機能を直接試すことができます。また、ブラウザベースが提供するデモ環境を通じて、AIが実際にウェブページをクリックし、入力する過程を体験できます。

グーグルは「AIが単に文を理解する段階を超え、今では実際の画面を操作し、人的作業を代替する段階に入った」と述べました。今後グーグルはこの技術を業務自動化、顧客サービス、テスト自動化など様々な産業分野に拡張する計画です。

AIは今や人間のように「考える」ことを超えて、実際に「行動」し始めました。ジェミナイ2.5コンピュータユーズモデルは単なる技術実験ではなく、人が日々使用するデジタル環境をAIが直接操作できる新たな局面を開く技術です。ボタンを押し、情報を入力し、ウェブを探る日常的なデジタル作業が徐々に自動化されてきています。AIはもはや単に助ける存在ではなく、直接働く同僚として近づいています。